10 | 案例篇:系统的软中断CPU使用率升高,我该怎么办?

讲述:冯永吉

时长12:47大小11.72M

你好,我是倪朋飞。

上一期我给你讲了软中断的基本原理,我们先来简单复习下。

中断是一种异步的事件处理机制,用来提高系统的并发处理能力。中断事件发生,会触发执行中断处理程序,而中断处理程序被分为上半部和下半部这两个部分。

-

上半部对应硬中断,用来快速处理中断;

-

下半部对应软中断,用来异步处理上半部未完成的工作。

Linux 中的软中断包括网络收发、定时、调度、RCU 锁等各种类型,我们可以查看 proc 文件系统中的 /proc/softirqs ,观察软中断的运行情况。

在 Linux 中,每个 CPU 都对应一个软中断内核线程,名字是 ksoftirqd/CPU 编号。当软中断事件的频率过高时,内核线程也会因为 CPU 使用率过高而导致软中断处理不及时,进而引发网络收发延迟、调度缓慢等性能问题。

软中断 CPU 使用率过高也是一种最常见的性能问题。今天,我就用最常见的反向代理服务器 Nginx 的案例,教你学会分析这种情况。

案例

你的准备

接下来的案例基于 Ubuntu 18.04,也同样适用于其他的 Linux 系统。我使用的案例环境是这样的:

-

机器配置:2 CPU、8 GB 内存。

-

预先安装 docker、sysstat、sar 、hping3、tcpdump 等工具,比如 apt-get install docker.io sysstat hping3 tcpdump。

这里我又用到了三个新工具,sar、 hping3 和 tcpdump,先简单介绍一下:

-

sar 是一个系统活动报告工具,既可以实时查看系统的当前活动,又可以配置保存和报告历史统计数据。

-

hping3 是一个可以构造 TCP/IP 协议数据包的工具,可以对系统进行安全审计、防火墙测试等。

-

tcpdump 是一个常用的网络抓包工具,常用来分析各种网络问题。

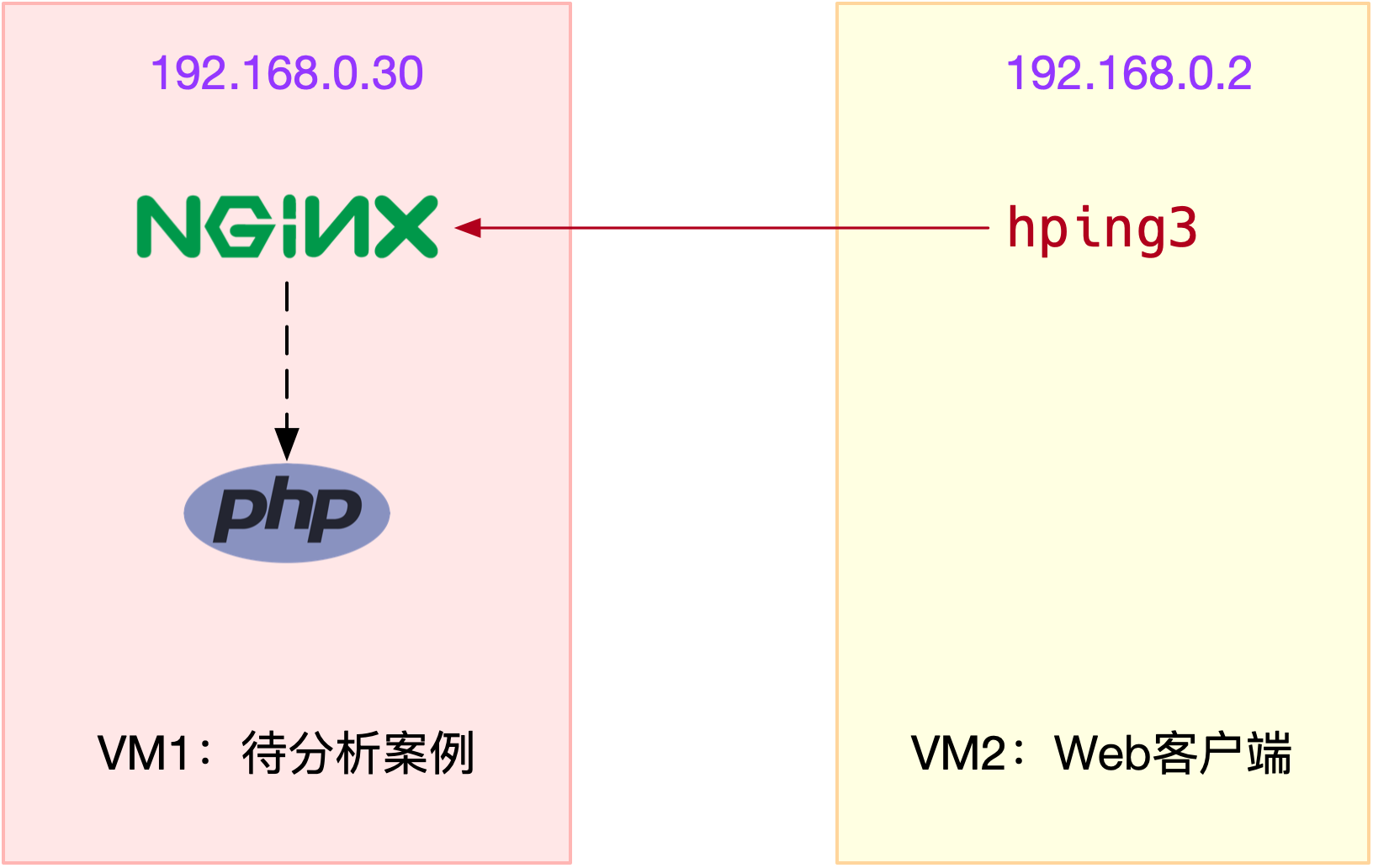

本次案例用到两台虚拟机,我画了一张图来表示它们的关系。

你可以看到,其中一台虚拟机运行 Nginx ,用来模拟待分析的 Web 服务器;而另一台当作 Web 服务器的客户端,用来给 Nginx 增加压力请求。使用两台虚拟机的目的,是为了相互隔离,避免“交叉感染”。

接下来,我们打开两个终端,分别 SSH 登录到两台机器上,并安装上面提到的这些工具。

同以前的案例一样,下面的所有命令都默认以 root 用户运行,如果你是用普通用户身份登陆系统,请运行 sudo su root 命令切换到 root 用户。

如果安装过程中有什么问题,同样鼓励你先自己搜索解决,解决不了的,可以在留言区向我提问。如果你以前已经安装过了,就可以忽略这一点了。

操作和分析

安装完成后,我们先在第一个终端,执行下面的命令运行案例,也就是一个最基本的 Nginx 应用:

然后,在第二个终端,使用 curl 访问 Nginx 监听的端口,确认 Nginx 正常启动。假设 192.168.0.30 是 Nginx 所在虚拟机的 IP 地址,运行 curl 命令后你应该会看到下面这个输出界面:

接着,还是在第二个终端,我们运行 hping3 命令,来模拟 Nginx 的客户端请求:

现在我们再回到第一个终端,你应该发现了异常。是不是感觉系统响应明显变慢了,即便只是在终端中敲几个回车,都得很久才能得到响应?这个时候应该怎么办呢?

虽然在运行 hping3 命令时,我就已经告诉你,这是一个 SYN FLOOD 攻击,你肯定也会想到从网络方面入手,来分析这个问题。不过,在实际的生产环境中,没人直接告诉你原因。

所以,我希望你把 hping3 模拟 SYN FLOOD 这个操作暂时忘掉,然后重新从观察到的问题开始,分析系统的资源使用情况,逐步找出问题的根源。

那么,该从什么地方入手呢?刚才我们发现,简单的 SHELL 命令都明显变慢了,先看看系统的整体资源使用情况应该是个不错的注意,比如执行下 top 看看是不是出现了 CPU 的瓶颈。我们在第一个终端运行 top 命令,看一下系统整体的资源使用情况。

这里你有没有发现异常的现象?我们从第一行开始,逐个看一下:

-

平均负载全是 0,就绪队列里面只有一个进程(1 running)。

-

每个 CPU 的使用率都挺低,最高的 CPU1 的使用率也只有 4.4%,并不算高。

-

再看进程列表,CPU 使用率最高的进程也只有 0.3%,还是不高呀。

那为什么系统的响应变慢了呢?既然每个指标的数值都不大,那我们就再来看看,这些指标对应的更具体的含义。毕竟,哪怕是同一个指标,用在系统的不同部位和场景上,都有可能对应着不同的性能问题。

仔细看 top 的输出,两个 CPU 的使用率虽然分别只有 3.3% 和 4.4%,但都用在了软中断上;而从进程列表上也可以看到,CPU 使用率最高的也是软中断进程 ksoftirqd。看起来,软中断有点可疑了。

根据上一期的内容,既然软中断可能有问题,那你先要知道,究竟是哪类软中断的问题。停下来想想,上一节我们用了什么方法,来判断软中断类型呢?没错,还是 proc 文件系统。观察 /proc/softirqs 文件的内容,你就能知道各种软中断类型的次数。

不过,这里的各类软中断次数,又是什么时间段里的次数呢?它是系统运行以来的累积中断次数。所以我们直接查看文件内容,得到的只是累积中断次数,对这里的问题并没有直接参考意义。因为,这些中断次数的变化速率才是我们需要关注的。

那什么工具可以观察命令输出的变化情况呢?我想你应该想起来了,在前面案例中用过的 watch 命令,就可以定期运行一个命令来查看输出;如果再加上 -d 参数,还可以高亮出变化的部分,从高亮部分我们就可以直观看出,哪些内容变化得更快。

比如,还是在第一个终端,我们运行下面的命令:

通过 /proc/softirqs 文件内容的变化情况,你可以发现, TIMER(定时中断)、NET_RX(网络接收)、SCHED(内核调度)、RCU(RCU 锁)等这几个软中断都在不停变化。

其中,NET_RX,也就是网络数据包接收软中断的变化速率最快。而其他几种类型的软中断,是保证 Linux 调度、时钟和临界区保护这些正常工作所必需的,所以它们有一定的变化倒是正常的。

那么接下来,我们就从网络接收的软中断着手,继续分析。既然是网络接收的软中断,第一步应该就是观察系统的网络接收情况。这里你可能想起了很多网络工具,不过,我推荐今天的主人公工具 sar 。

sar 可以用来查看系统的网络收发情况,还有一个好处是,不仅可以观察网络收发的吞吐量(BPS,每秒收发的字节数),还可以观察网络收发的 PPS,即每秒收发的网络帧数。

我们在第一个终端中运行 sar 命令,并添加 -n DEV 参数显示网络收发的报告:

对于 sar 的输出界面,我先来简单介绍一下,从左往右依次是:

-

第一列:表示报告的时间。

-

第二列:IFACE 表示网卡。

-

第三、四列:rxpck/s 和 txpck/s 分别表示每秒接收、发送的网络帧数,也就是 PPS。

-

第五、六列:rxkB/s 和 txkB/s 分别表示每秒接收、发送的千字节数,也就是 BPS。

-

后面的其他参数基本接近 0,显然跟今天的问题没有直接关系,你可以先忽略掉。

我们具体来看输出的内容,你可以发现:

-

对网卡 eth0 来说,每秒接收的网络帧数比较大,达到了 12607,而发送的网络帧数则比较小,只有 6304;每秒接收的千字节数只有 664 KB,而发送的千字节数更小,只有 358 KB。

-

docker0 和 veth9f6bbcd 的数据跟 eth0 基本一致,只是发送和接收相反,发送的数据较大而接收的数据较小。这是 Linux 内部网桥转发导致的,你暂且不用深究,只要知道这是系统把 eth0 收到的包转发给 Nginx 服务即可。具体工作原理,我会在后面的网络部分详细介绍。

从这些数据,你有没有发现什么异常的地方?

既然怀疑是网络接收中断的问题,我们还是重点来看 eth0 :接收的 PPS 比较大,达到 12607,而接收的 BPS 却很小,只有 664 KB。直观来看网络帧应该都是比较小的,我们稍微计算一下,664*1024/12607 = 54 字节,说明平均每个网络帧只有 54 字节,这显然是很小的网络帧,也就是我们通常所说的小包问题。

那么,有没有办法知道这是一个什么样的网络帧,以及从哪里发过来的呢?

使用 tcpdump 抓取 eth0 上的包就可以了。我们事先已经知道, Nginx 监听在 80 端口,它所提供的 HTTP 服务是基于 TCP 协议的,所以我们可以指定 TCP 协议和 80 端口精确抓包。

接下来,我们在第一个终端中运行 tcpdump 命令,通过 -i eth0 选项指定网卡 eth0,并通过 tcp port 80 选项指定 TCP 协议的 80 端口:

从 tcpdump 的输出中,你可以发现

-

192.168.0.2.18238 > 192.168.0.30.80 ,表示网络帧从 192.168.0.2 的 18238 端口发送到 192.168.0.30 的 80 端口,也就是从运行 hping3 机器的 18238 端口发送网络帧,目的为 Nginx 所在机器的 80 端口。

-

Flags [S] 则表示这是一个 SYN 包。

再加上前面用 sar 发现的, PPS 超过 12000 的现象,现在我们可以确认,这就是从 192.168.0.2 这个地址发送过来的 SYN FLOOD 攻击。

到这里,我们已经做了全套的性能诊断和分析。从系统的软中断使用率高这个现象出发,通过观察 /proc/softirqs 文件的变化情况,判断出软中断类型是网络接收中断;再通过 sar 和 tcpdump ,确认这是一个 SYN FLOOD 问题。

SYN FLOOD 问题最简单的解决方法,就是从交换机或者硬件防火墙中封掉来源 IP,这样 SYN FLOOD 网络帧就不会发送到服务器中。

至于 SYN FLOOD 的原理和更多解决思路,你暂时不需要过多关注,后面的网络章节里我们都会学到。

案例结束后,也不要忘了收尾,记得停止最开始启动的 Nginx 服务以及 hping3 命令。

在第一个终端中,运行下面的命令就可以停止 Nginx 了:

然后到第二个终端中按下 Ctrl+C 就可以停止 hping3。

小结

软中断 CPU 使用率(softirq)升高是一种很常见的性能问题。虽然软中断的类型很多,但实际生产中,我们遇到的性能瓶颈大多是网络收发类型的软中断,特别是网络接收的软中断。

在碰到这类问题时,你可以借用 sar、tcpdump 等工具,做进一步分析。不要害怕网络性能,后面我会教你更多的分析方法。

思考

最后,我想请你一起来聊聊,你所碰到的软中断问题。你所碰到的软中问题是哪种类型,是不是这个案例中的小包问题?你又是怎么分析它们的来源并解决的呢?可以结合今天的案例,总结你自己的思路和感受。如果遇到过其他问题,也可以留言给我一起解决。

欢迎在留言区和我讨论,也欢迎你把这篇文章分享给你的同事、朋友。我们一起在实战中演练,在交流中进步。

精选留言(70)

- 倪朋飞 置顶2018-12-12 23统一回复一下终端卡顿的问题,这个是由于网络延迟增大(甚至是丢包)导致的。比如你可以再拿另外一台机器(也就是第三台)在 hping3 运行的前后 ping 一下案例机器,ping -c3 <ip>

hping3 运行前,你可能看到最长的也不超过 1 ms:

3 packets transmitted, 3 received, 0% packet loss, time 2028ms

rtt min/avg/max/mdev = 0.815/0.914/0.989/0.081 ms

而 hping3 运行时,不仅平均延迟增长到了 245 ms,而且还会有丢包的发生:

3 packets transmitted, 2 received, 33% packet loss, time 2026ms

rtt min/avg/max/mdev = 240.637/245.758/250.880/5.145 ms

网络问题的排查方法在后面的文章中还会讲,这儿只是从 CPU 利用率的角度出发,你可以发现也有可能是网络导致的问题。展开 - 2xshu2018-12-12 9老师,网络软中断明明只占了百分之四左右。为什么终端会感觉那么卡呢?不是很理解这点呢

作者回复: 参考置顶回复

- 赵强强2018-12-12 8倪老师,案例中硬中断CPU占用率为啥是0呢,硬中断和软中断次数不是基本一致的吗?

- Days2018-12-13 6软终端不高导致系统卡顿,我的理解是这样的,其实不是系统卡顿,而是由于老师用的ssh远程登录,在这期间hping3大量发包,导致其他网络连接延迟,ssh通过网络连接,使ssh客户端感觉卡顿现象。

作者回复: 正解👍

- 卿卿子衿2018-12-12 6有同学说在查看软中断数据时会显示128个核的数据,我的也是,虽然只有一个核,但是会显示128个核的信息,用下面的命令可以提取有数据的核,我的1核,所以这个命令只能显示1核,多核需要做下修改

watch -d "/bin/cat /proc/softirqs | /usr/bin/awk 'NR == 1{printf \"%13s %s\n\",\" \",\$1}; NR > 1{printf \"%13s %s\n\",\$1,\$2}'"展开作者回复: 谢谢分享

- 向阳胜2018-12-27 4搞运维好些年了。一些底层性能的东西,感觉自己始终是一知半解,通过这个专栏了解的更深入了,确实学到了很多。而且老师也一直在积极回复同学们的问题,相比某些专栏的老师发出来就不管的状态好太多。给老师点赞。展开

作者回复: 也很高兴看到大家有所收获😊

- 我来也2018-12-12 3[D10打卡]

"hping3 -S -p 80 -i u100 192.168.0.30" 这里的u100改为了1 也没觉得终端卡,top的软中断%si倒是从4%上升了不少,吃满了一个cpu.

可能是我直接在宿主机上开终端的原因,本身两个虚拟机都在这个宿主机上,都是走的本地网络.

本地网卡可能还处理的过来.

-----------

在工作中,倒是没有遇到小包导致的性能问题.

也许是用户数太少,流量不够.[才二三十兆带宽], 也许是之前发生了,自己并不知道.

在工作中遇到的软中间导致的性能问题就是上期说的usleep(1)了.

-----------

本期又学到新东西了:

1.sar 原来可以这么方便的看各网卡流量,甚至是网络帧数.

到目前为止,我都是用的最原始的方法:在网上找的一个脚本,分析ifconfig中的数据,来统计某个网卡的流量.一来需要指定某个网卡(默认eth0),二来显示的数据不太准确且不友好(sleep 1做差值).

2.nping3 居然可以用来模拟SYN FLOOD. (不要用来做坏事哦)

3.tcpdump 之前有所耳闻. 用的不多. 平常有解包需求,都是在windows下用wireshark,毕竟是图形界面.

-----------

有同学说"仅凭tcpdump发现一个syn包就断定是SYN FLOOD,感觉有些草断"

我是这样认为的:

你tcpdump 截取一段时间的日志, 除去正常的流量, 着重分析异常的,再根据ip来统计出现的次数, 还是可以合理推理出来老师结论的.

毕竟平常不会有哪个ip每秒产生这么多的syn,且持续这么长时间.展开作者回复: 👍

最后一个问题其实前面已经看到PPS了 - 黄海峰2018-12-12 3这真是非常干货和务实的一个专栏,这么便宜,太值了。。。

作者回复: 😊

- xfan2018-12-12 2ssh的tty其实也是通过网络传输的,既然是经过网卡,当然会卡,这就是攻击所带来的结果

作者回复: 对的

- Vicky🐣...2018-12-12 21. 网络收发软中断过多导致命令行比较卡,是因为键盘敲击命令行属于硬中断,内核也需要去处理的原因吗?

2. 观察/proc/softirqs,发现变化的值是TIMER、NET_RX、BLOCK、RCU,奇怪的是SCHED一直为0,求老师解答展开作者回复: 我们是SSH登陆的机器,还是走网络而不是键盘中断😓

- 几叶星辰2019-01-24 1怎么让网卡中断平衡呢,可以请教下linux 2.6.40。中断平衡问题吗,以及内核版本更高的版本?

作者回复: 配置 smp_affinity 或者开启 irqbalance 服务

- 男人十八一...2018-12-17 1cat /proc/softirqs时我有4个cpu,可用

watch -d "/bin/cat /proc/softirqs | /usr/bin/awk 'NR == 1{printf \"%-15s %-15s %-15s %-15s %-15s\n\",\" \",\$1,\$2,\$3,\$4}; NR > 1{printf \"%-15s %-15s %-15s %-15s %-15s\n\",\$1,\$2,\$3,\$4,\$5}'"

查看展开作者回复: 谢谢分享👍 不懂awk的赶紧去学习😊

- Vicky🐣...2018-12-12 1执行了一下hping3,机器直接卡死了,登录不上去了,哈哈

作者回复: 可能太猛了,调整下参数再试试

- chenjt2018-12-12 1同问,这种情况下cpu使用率这么低,为什么会感到卡顿呢

作者回复: 参考置顶回复

- bluefantas...2018-12-12 1老师,既然软中断并没有占用太多cpu资源,为啥会影响其他任务的性能?

作者回复: 参考置顶回复

- zqing2018-12-12 1同问:老师,网络软中断明明只占了百分之四左右。为什么终端会感觉那么卡呢?不是很理解这点呢

作者回复: 参考置顶回复

- shawn2019-05-06既然卡顿是由于网络攻击造成的,并且cpu的使用率没有提高,那么标题可否换一下呢?

作者回复: 不是没有提高,而是提高了,但提高的不是很明显。不过,即便不明显,也是排查问题的线索

- 聰2019-05-03把hping3调到u1去发动攻击,在node1上发现一种奇特的现象,cpu0 的使用率很低,但高软中断,会导致低的idle ,请教老师为什么会这样.

[root@master ~]# mpstat -P ALL 1

Linux 3.10.0-957.10.1.el7.x86_64 (master) 05/03/2019 _x86_64_ (2 CPU)

11:02:07 AM CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

11:02:08 AM all 0.00 0.00 0.00 0.00 0.00 44.79 0.00 0.00 0.00 55.21

11:02:08 AM 0 0.00 0.00 0.00 0.00 0.00 91.49 0.00 0.00 0.00 8.51

11:02:08 AM 1 0.00 0.00 0.00 0.00 0.00 0.00 0.00 0.00 0.00 100.00

11:02:08 AM CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

11:02:09 AM all 0.51 0.00 1.02 0.00 0.00 43.65 0.00 0.00 0.00 54.82

11:02:09 AM 0 0.00 0.00 1.01 0.00 0.00 86.87 0.00 0.00 0.00 12.12

11:02:09 AM 1 0.00 0.00 1.03 0.00 0.00 0.00 0.00 0.00 0.00 98.97

11:02:09 AM CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

11:02:10 AM all 0.00 0.00 0.00 0.00 0.00 50.00 0.00 0.00 0.00 50.00

11:02:10 AM 0 0.00 0.00 0.00 0.00 0.00 100.00 0.00 0.00 0.00 0.00

11:02:10 AM 1 0.00 0.00 1.01 0.00 0.00 0.00 0.00 0.00 0.00 98.99

Average: CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

Average: all 0.26 0.00 0.64 0.00 0.00 45.19 0.00 0.00 0.00 53.92

Average: 0 0.00 0.00 0.26 0.00 0.00 91.43 0.00 0.00 0.00 8.31

Average: 1 0.25 0.00 1.02 0.00 0.00 0.00 0.00 0.00 0.00 98.73展开 - Leon📷2019-05-01老师,我有个疑惑,cpu使用率和用户cpu和系统cpu,iowait还有软硬中断有关,我们这几篇讲iowait和软中断,都是软中断和iowait很高,但是cpu的使用率却并没有上升,如果没有直接关联性,那iowait和软硬中断怎么算影响cpu使用率的影响因子呢展开

作者回复: 仔细看的话,CPU使用率都有升高,只是可能没有你想象的那么高

- manatee2019-04-25继续打卡,使用hping3 即使设置参数为-i u10,被攻击的机器仍旧不卡。

作者回复: 是不是被攻击机器已经做过调优了?或者被攻击机器本身性能比攻击机器高?